Làm cách nào để bạn cấp quyền cho các công cụ trí tuệ nhân tạo (AI) tinh vi trong khi vẫn tôn trọng quyền riêng tư và bảo vệ quyền sở hữu trí tuệ của tài sản dữ liệu? Một công ty khởi nghiệp có trụ sở tại Berlin tin rằng liên kết học sẽ tiết lộ câu trả lời.

Kiến thức liên đoàn dựa trên niềm tin rằng “dữ liệu nhạy cảm được lưu giữ cục bộ tốt nhất và

dưới sự kiểm soát của bộ điều khiển dữ liệu” và mang lại kết quả “tốt như thể bạn có tất cả dữ liệu trên máy chủ của riêng mình”, Lucie Arntz nói, Trưởng bộ phận pháp lý tại Apheris.

(Ảnh: Courtesy of Apheris)

Trong bài phát biểu khai mạc của mình tại phiên họp thứ tư của WIPO Talkshow về Sở hữu Trí tuệ và Công nghệ biên giới vào tháng 9 năm 2021 (đọc Dữ liệu: nhiên liệu biến đổi nền kinh tế toàn cầu ), Tổng giám đốc WIPO Daren Tang đã mô tả dữ liệu là “nhiên liệu” thúc đẩy số hóa. Các thuật toán cho máy học (machine learning) yêu cầu khối lượng lớn dữ liệu để học – nhưng điều gì sẽ xảy ra khi dòng nhiên liệu bị gián đoạn, hay nói cách khác là khi dữ liệu không thể được chia sẻ vì lý do bảo vệ quyền riêng tư, bảo mật hoặc sở hữu trí tuệ (IP)?

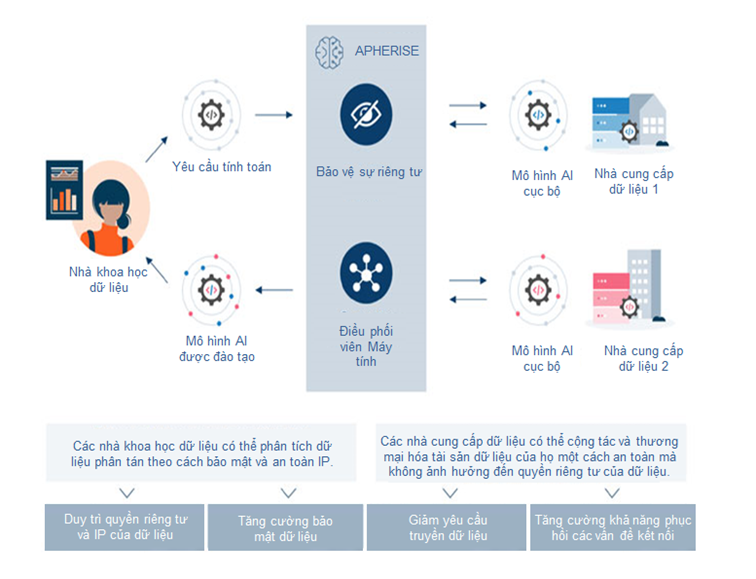

Một giải pháp cho vấn đề đó được gọi là liên kết học, nơi dữ liệu không bao giờ rời khỏi sự kiểm soát của chủ sở hữu dữ liệu. Thay vào đó, các thuật toán học máy được đào tạo trên dữ liệu cục bộ mà không cần chia sẻ dữ liệu. Trong một ví dụ đơn giản, dữ liệu nhạy cảm như hồ sơ bệnh nhân từ bệnh viện có thể được sử dụng để phát triển một loại thuốc mới của một công ty dược phẩm mà bệnh viện không cần phải tiết lộ bất kỳ dữ liệu nào. Trong những trường hợp phức tạp hơn, dữ liệu từ nhiều nguồn có thể được sử dụng để đào tạo cùng một thuật toán, mang lại lợi ích cả về khối lượng và tính đa dạng.

Liên kết học yêu cầu một bên thứ ba đáng tin cậy để tập hợp thuật toán và chủ sở hữu dữ liệu lại với nhau. Công ty khởi nghiệp Apheris có trụ sở tại Berlin, được ra mắt vào năm 2019, là một trong những công ty như vậy. Apheris có một nhóm gồm khoảng 20 nhà phát triển, chuyên gia về quyền riêng tư và nhà khoa học dữ liệu. Những cá nhân tài năng này cung cấp một nền tảng an toàn để chia sẻ dữ liệu an toàn. Giám đốc Pháp lý của công ty, Lucie Arntz, gần đây đã nói chuyện với Tạp chí WIPO về mô hình kinh doanh, bảo vệ và bảo mật dữ liệu của công ty.

Lợi ích của liên kết học

Bà Arntz gia nhập Apheris vào mùa hè năm 2020 – nhân viên đầu tiên không phải là nhà khoa học – và chịu trách nhiệm đảm bảo nền tảng pháp lý phù hợp, bảo vệ quyền lợi của khách hàng và giám sát các hợp đồng. Bà ấy nói rằng liên kết học dựa trên niềm tin rằng “dữ liệu nhạy cảm được lưu giữ cục bộ tốt nhất và dưới sự kiểm soát của bộ điều khiển dữ liệu” và nó mang lại kết quả “tốt như thể bạn có tất cả dữ liệu trên máy chủ của riêng mình”.

Cho đến nay, những lợi ích đã được thể hiện rõ ràng nhất trong lĩnh vực chăm sóc sức khỏe – nơi mà có các kỹ thuật AI tiên tiến và cũng có những lo ngại cơ bản về dữ liệu bệnh nhân bí mật và nhạy cảm. Nhưng bà Arntz chỉ ra rằng liên kết học mang lại lợi ích ngay cả khi dữ liệu không nhạy cảm đối với thông tin nhận dạng cá nhân. Ví dụ: Apheris hiện đang làm việc trong một dự án cho một nhà sản xuất hóa chất, liên quan đến dữ liệu sản phẩm và khách hàng nhạy cảm và bí mật về mặt thương mại. Liên kết học cũng có thể áp dụng khi một số dữ liệu nhất định được bảo vệ bằng quyền sở hữu trí tuệ.

Bà Arntz cho biết: “Tập trung hóa dữ liệu đang trở nên lỗi thời, và cho biết thêm rằng nhiều công ty sở hữu một lượng lớn dữ liệu có giá trị mà không được tận dụng vì lo ngại về việc chia sẻ:“ Bạn có thể có nhiều dữ liệu có thể cực kỳ quan trọng đối với người khác nhưng không quan trọng đối với bạn, vì vậy nếu không hợp tác với ai đó thì dữ liệu đó cũng không có giá trị gì cả. “

Trong một số trường hợp, giá trị của dữ liệu chỉ có thể rõ ràng khi nó được kết hợp với dữ liệu từ các nguồn khác thông qua liên kết học. Ví dụ: dữ liệu y tế từ bệnh nhân ở Hoa Kỳ có thể được bổ sung với dữ liệu từ châu Phi hoặc châu Á, dẫn đến bộ dữ liệu thử nghiệm lâm sàng đa dạng hơn. Bà Arntz nói: “Bạn có thể mở rộng quy mô bao nhiêu tùy thích và đó là nơi nó trở nên kỳ diệu.

Nhưng bà ấy nói thêm rằng tiềm năng của việc liên kết học có lẽ vẫn còn ba năm nữa mới được thực hiện. Một lý do là cần tiêu chuẩn hóa nhiều hơn trong việc thu thập và định dạng dữ liệu. Trong khi khả năng tính toán tăng lên cho phép xử lý khối lượng dữ liệu lớn hơn, để có kết quả tối ưu, dữ liệu cần được kết cấu tốt để cho phép cộng tác dữ liệu an toàn. Ở đây, một lần nữa, lĩnh vực chăm sóc sức khỏe đang tiên phong, nhưng các lĩnh vực khác cũng đang dần bắt kịp xu thế phát triển. Một trong những điều mà bà Arntz xác định là ngành công nghiệp ô tô, nơi mà sự phát triển của các phương tiện tự hành một phần và hoàn toàn phụ thuộc vào việc phân tích nhiều dữ liệu từ nhiều nguồn khác nhau – bao gồm tài xế, phương tiện, cơ quan quản lý đường cao tốc, cơ quan thực thi pháp luật và công ty bảo hiểm. Bà nói: “Ngành công nghiệp ô tô rất tập trung vào việc đưa ra tiêu chuẩn đó.Chúng tôi rất quan tâm đến việc có thể cộng tác trên dữ liệu đó và có những nỗ lực để các nhà sản xuất lớn cùng nhau chuẩn hóa. Đây là một lĩnh vực đặc biệt thú vị vì nó liên quan đến sự tương tác của cả khu vực công và khu vực tư”. Trong lĩnh vực ô tô, giải pháp có thể là tự nguyện và do ngành dẫn đầu, nhưng sẽ cần thời gian để phát triển.

Trong khi khả năng tính toán tăng lên cho phép xử lý khối lượng dữ liệu lớn hơn, để có kết quả tối ưu, dữ liệu cần được kết cấu tốt để cho phép cộng tác dữ liệu 1 cách an toàn.

Bài toán hóc búa về ẩn danh

Một thách thức lớn đối với sự phát triển của các công cụ AI là mức độ ẩn danh. Các cá nhân luôn quan tâm đến việc bảo vệ dữ liệu cá nhân của họ (cho dù tiền sử bệnh tật hoặc gia đình, thông tin tài chính hoặc các chi tiết cá nhân khác) nhưng, theo bà Arntz nói, “dữ liệu càng ẩn danh thì dữ liệu đó càng ít liên quan hơn. Ẩn danh không phải là tương lai của học máy”. Ví dụ, phát triển và thử nghiệm thuốc hiệu quả cần tính đến tuổi tác, dân tộc, dị ứng, thuốc và các yếu tố khác; ô tô tự lái cần thông tin về nơi bạn đang đi, loại xe bạn lái và tốc độ bạn muốn đi. Bà Arntz tin rằng việc liên kết học có thể giúp mang lại sự cân bằng và cho thấy rằng “không phải là xung đột khi có cả quyền riêng tư và sự đổi mới”.

Vượt qua những thách thức như vậy đòi hỏi sự kết hợp của các giải pháp công nghệ và pháp lý: công nghệ có thể đảm bảo tính bảo mật của dữ liệu thông qua các quy trình được kiểm tra nghiêm ngặt và cường độ cao, trong khi luật cho phép các hợp đồng quy định ai kiểm soát dữ liệu, ai có thể nhận kết quả và mức độ chi tiết họ nhận được.

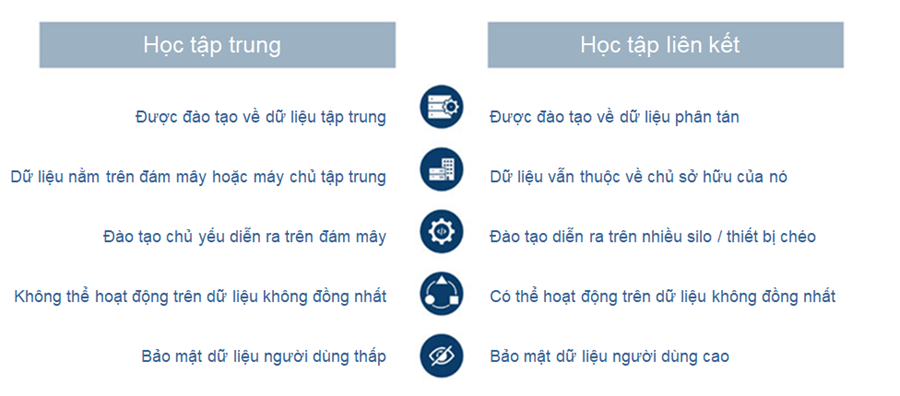

So sánh giữa học tập trung và liên kết học

Bà Arntz nói: “Tập trung hóa dữ liệu đang trở nên lỗi thời . “Bạn có thể có nhiều dữ liệu có thể là cực kỳ quan trọng đối với người khác nhưng với bạn thì không, vì vậy nếu không hợp tác với ai đó thì dữ liệu đó không có giá trị gì cả”.

Làm thế nào dữ liệu thực sự được bảo vệ vẫn là một câu hỏi khó: trong khi luật bản quyền và các công cụ sui generis như quyền cơ sở dữ liệu ở Liên minh Châu Âu có thể cung cấp một số biện pháp bảo vệ, các ranh giới không rõ ràng và hầu hết các tổ chức có khả năng ưu tiên giữ dữ liệu an toàn, dựa trên các điều khoản hợp đồng và bảo vệ theo bí mật thương mại hoặc luật thông tin bí mật. Nhưng bà Arntz nói rằng vấn đề liệu dữ liệu có được bảo vệ hay không và như thế nào không cần phải là vấn đề: “Nếu bạn có dữ liệu, bạn có thể nghĩ rằng nó quan trọng và cần được bảo vệ. Đối với liên kết học, không quan trọng dữ liệu có được bảo vệ chính thức hay không. Chúng tôi đã sai ở khía cạnh an toàn. “

Bà tin rằng một vấn đề cấp bách hơn là “sự đồng ý rộng rãi”. GDPR thừa nhận rằng không phải lúc nào các nhà nghiên cứu khoa học cũng có thể xác định được tất cả các mục đích mà dữ liệu được thu thập. Do đó, họ có thể không phải cụ thể hóa về kế hoạch của họ trong các lĩnh vực khác, nhưng tuy nhiên nên cung cấp các tùy chọn để chủ thể dữ liệu có thể đưa ra sự đồng ý cho việc sử dụng nghiên cứu trong tương lai. “Chúng tôi cần hướng dẫn rõ ràng hơn về ‘mục đích nghiên cứu’ là gì. Hiện tại, có sự không chắc chắn đối với các trường đại học và các nhà nghiên cứu và điều đó đang hạn chế sự đổi mới, ”bà nói.

Làm sáng tỏ quy định công bằng

Bà Arntz tin rằng GDPR là một ví dụ về luật “bị chỉ trích nhiều nhưng cũng được yêu thích nhiều”: nó cung cấp cơ sở hợp lý để bảo vệ dữ liệu nhưng sẽ cần được cập nhật khi công nghệ thay đổi. “Trên tất cả, chúng tôi cần sự rõ ràng: ngay cả khi hướng dẫn là bạn không thể làm điều gì đó, thì ít nhất cũng tốt để có một đường lối rõ ràng.”

Bà cũng lập luận rằng GDPR là một ví dụ về cách một khu vực – trong trường hợp này là EU – có thể “chiếu sáng” để thúc đẩy quy định công bằng: như bà nói, dữ liệu không thể chỉ được quản lý trên phạm vi quốc gia vì vậy cần có các giải pháp đa quốc gia hoặc quốc tế – ngay cả khi các thỏa hiệp phải được thực hiện trên đường đi. Bà lạc quan rằng các sáng kiến mới của EU, chẳng hạn như Đạo luật quản trị dữ liệu được thông qua gần đây và Đạo luật AI được đề xuất, sẽ cung cấp thêm thông tin rõ ràng: “Chính sách phải luôn cởi mở để tối ưu hóa. Chúng tôi sẽ cần phải điều chỉnh nó trong tương lai và xem xét lại những gì chúng tôi đang cố gắng đạt được. “

Tuy nhiên, bà cảnh báo rằng quá trình này phải có tính bao trùm và liên ngành: quá nhiều lần các chuyên gia kinh doanh, pháp lý, chính sách và kỹ thuật không ở cùng một phòng hoặc thậm chí nói cùng một ngôn ngữ, và tiếng nói của các công ty khởi nghiệp và doanh nghiệp vừa và nhỏ không phải lúc nào cũng được lắng nghe. “Các chính phủ nói chuyện với các tập đoàn lớn rất nhiều nhưng nếu họ không nói chuyện với các công ty khởi nghiệp, họ sẽ không nghe được về các công nghệ đổi mới,” bà Arntz giải thích.

Bà nói, cuộc trò chuyện rất quan trọng bởi vì công nghệ ngày càng trở nên phức tạp hơn và có nguồn tài chính dồi dào dành cho các sản phẩm và dịch vụ mới có nguồn gốc từ AI và phân tích dữ liệu. Tầm quan trọng của dữ liệu là rõ ràng trong mọi thứ, từ giải quyết đại dịch COVID-19 đến đánh giá tác động của biến đổi khí hậu. Bà Arntz nói: “Chúng ta sẽ thấy rất nhiều sự phát triển trong phân tích dữ liệu và chính sách sẽ phải thay đổi để đáp ứng điều này.”

Dữ liệu ở EU – hiện có và được đề xuất

Quy định chung về bảo vệ dữ liệu (GDPR): GDPR năm 2016 đã thay thế Chỉ thị bảo vệ dữ liệu của Liên minh Châu Âu và quy định việc xử lý dữ liệu cá nhân của các chủ thể dữ liệu trong Khu vực kinh tế Châu Âu. Nó đã được tuân theo ở nhiều quốc gia và khu vực khác, chẳng hạn như trong Đạo luật về quyền riêng tư của người tiêu dùng California (2018).

Đạo luật quản trị dữ liệu : Đạo luật đã được Nghị viện Châu Âu thông qua vào ngày 6 tháng 4 năm 2022. Đạo luật này được Nghị viện Châu Âu báo trước là một động thái “kích thích sự đổi mới và giúp các công ty khởi nghiệp và doanh nghiệp sử dụng dữ liệu lớn”. Các quy tắc sẽ mang lại lợi ích cho doanh nghiệp bằng cách giảm chi phí dữ liệu và các rào cản gia nhập thị trường. Chẳng hạn, người tiêu dùng sẽ được hưởng lợi khi được tiếp cận với mức tiêu thụ năng lượng thông minh hơn và lượng khí thải thấp hơn. Các quy tắc cũng được thiết kế để xây dựng lòng tin bằng cách giúp chia sẻ dữ liệu dễ dàng hơn và an toàn hơn bằng cách đảm bảo dữ liệu tuân thủ luật bảo vệ dữ liệu. Chúng cũng sẽ tạo điều kiện thuận lợi cho việc tái sử dụng một số loại dữ liệu khu vực công, tăng cường sự tin tưởng vào các dữ liệu trung gian và thúc đẩy sự chia sẻ dữ liệu vì lợi ích của xã hội. Đạo luật sẽ tạo ra “các quy trình và cấu trúc” để giúp các công ty, cá nhân và khu vực công chia sẻ dữ liệu dễ dàng hơn. Nó sẽ phải được thông qua bởi tất cả các nước EU trong Hội đồng trước khi nó trở thành luật.

Đạo luật dữ liệu của EU : Đạo luật, còn được gọi là Quy định đề xuất về các quy tắc hài hòa về truy cập và sử dụng dữ liệu hợp lý, đã được Ủy ban châu Âu thông qua vào tháng 2 năm 2022 và là một trụ cột chính của chiến lược dữ liệu châu Âu. Nó làm rõ ai có thể tạo ra giá trị từ dữ liệu và các điều kiện mà họ có thể làm như vậy.

Đạo luật trí tuệ nhân tạo : Đề xuất về Quy định AI nhằm đặt ra các quy tắc hài hòa cho EU là một phần trong gói AI của Ủy ban châu Âu được công bố vào tháng 4 năm 2021. Đây là nỗ lực đầu tiên nhằm “ban hành quy định ngang về AI” và được thiết kế để biến Châu Âu thành trung tâm toàn cầu cho AI lấy con người làm trung tâm và đáng tin cậy.

Dịch từ bài viết “Apheris: solving the data privacy dilemma” của James Nurton, freelance writer trên WIPO